Каждый, имеющий отношение к интернет-маркетингу, знает, что такое сплит-тестирование. Но мы не знаем, или же боимся признать, что слишком многие тесты не дают ничего. Часто маркетологами тестируются бессмысленные варианты, дающие неоднозначные результаты, от анализа которых ничего не происходит.

Конечно, от некоторых экспериментов есть измеримый эффект. Это те кейсы, о которых вы слышали — именно они описаны в специализированных блогах. Мы все видели статьи с заголовками вроде «Компания Х повысила конверсию на 38% с помощью этого простого трюка».

Множество таких постов вы можете найти и в нашем блоге. Но эти выдающиеся истории успеха маскируют бездонную яму бессмысленных испытаний и экспериментов.

Так почему большинство тестов бесполезны?

По данным агентства AppSumo, только 1 из 8 тестов дает результат. По оценкам Kaiser Fung, от 80 до 90% тестирований на выходе дают статистически незначительные результаты. Тем не менее, все новые и новые маркетологи запускают сплит-тесты, ожидая быстро получить реальный эффект. Они думают, что после нескольких циклов найдут идеальный оттенок СТА-кнопки, и конверсия тут же вырастет на заветные 38%. Затем запускаются тесты на мобильных сайтах или приложениях, и тут реальность начинает подступать. Испытания становятся бесконечными, а результаты — либо «статистически незначительными», либо попросту никакими. Что происходит? Где же невероятный рост и одобрение начальства?

Не расстраивайтесь. Если вы занялись А/В-тестированием, то некоторые из тестов не принесут никаких результатов. Но со временем вы будете видеть меньше неудач и больше успешных примеров. Осмысляя полученный опыт, вы получите значимые результаты и информацию для реального улучшения продукта. Но зависит ли это от качества тестов, или же сам факт глубокого погружения в продукт и поведение пользователе открывает вам новые пути?

Все это создает впечатление, что вы учитесь новому из каждого очередного теста, что не совсем верно. Однако никто (или почти никто) не садится писать пост в блог о сплит-тесте трех вариантов, не давшем существенных результатов. Это означает, что статистически незначительных результатов бывает достаточно, чтобы сделать выводы из эксперимента. По сути, вопрос сводится к тому, каков шанс получить тот же эффект, или даже больший разброс в эффективности, если между вариантами А и В вообще не будет разницы. То есть, мы уже говорим не столько об оптимизации конверсии, сколько о теории вероятности.

Представьте, что вы подбрасываете две монеты, по 12 раз каждую. Монета А падает орлом все 12, а монета В — 9 раз. Увидев это, вы же не станете писать статьи о том, что нашли монету (или технологию подбрасывания), повышающую на 33% конверсию в падение орлом? Из вашего опыта вы поймете, что это просто случайность. Но представим, что вы желаете укрепить статистическую достоверность, и подбрасываете обе монеты уже по 180 раз. А падает орлом 120, а В — 90 раз. Искушенный в сплит-тестах маркетолог скажет, что результаты предыдущего испытания уточнились, хотя тенденция сохранилась — монета А эффективнее. Но мы же знаем, что это только случай. Можете подбрасывать монеты хоть по 2000 раз и тщательно анализировать результаты, но любое различие в показателях — только «белый шум», не дающий реальной информации.

Описанный пример может показаться глупым и некорректным. Зачем выставлять маркетологов дураками — ведь все знают, что две монеты идентичны, а с тестируемыми элементами не все так однозначно. Но проблема в том, что пример достаточно корректен — ведь именно здесь и кроется причина неоднозначных результатов большинства А/В-тестов. Мы тратим свое время на тестирование элементов, не имеющих существенных различий, и в результате имеем дело с массивами статистически незначительной информации. И большая часть вины лежит на множестве глупых кейсов и экспериментов с цветами и размерами СТА-кнопок.

Тестинг цвета кнопки — это первое слово маркетолога, сказанное в мире сплит-тестирования. То есть, такие примеры отлично объясняют концепцию и позволяют «набить руку». Прежде чем разрабатывать действительно глубокие тесты, удобно опробовать технологию, запустив испытание зеленой и красной кнопки «Купить». Вы соберете данные и увидите, какой вариант лучше влияет на конверсию.

Кроме того, некоторые компании действительно достигли выдающихся результатов через подобные эксперименты — был существенно улучшен продукт и оптимизирована конверсия. И конечно, если вы хотите, чтобы пользователи активно взаимодействовали с элементом, его стоит грамотно выделить, акцентировать внимание на нем. Но тем не менее, в большинстве случаев тесты цвета кнопок редко конструктивны в плане реального улучшения продукта.

Кейс: как смена темы письма не привела ни к чему

Для иллюстрации принципа рассмотрим кейс одного бессмысленного теста от Mixpanel. Компания редко рассылает электронные письма по основному листу подписчиков. Обычно рассылка ограничивается уведомлениями о новых статьях, и только по базе подписавшихся на блог. Но после существенного обновления платформы, затронувшего большую часть пользователей, было решено дать email-рассылку по всей базе клиентов, а заодно провести полномасштабный и быстрый сплит-тест.

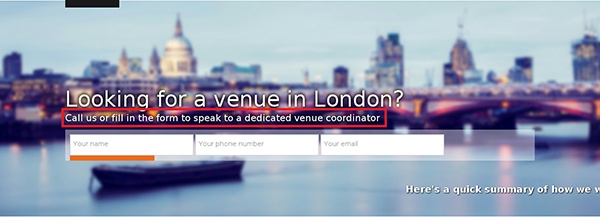

Темой письма была выбрана следующая фраза: «Почему 15 миллионов пользователей недостаточно хороши для этого пустякового мобильного приложения?». Но позже маркетологи вспомнили, что упоминание бренда в теме может увеличить коэффициент открываемости. Тогда вторым вариантом стало: «Mixpanel — почему 15 миллионов пользователей недостаточно хороши для этого пустякового мобильного приложения?».

Четко и ясно, не правда ли? Если бы тесты показали, что второй вариант эффективнее, это определило бы последующие действия маркетологов. Наверняка они использовали бы имя бренда во всех рассылках и прочих рекламных активностях. Итак, рассылка была разослана сотням тысяч пользователей, разделенных на две группы. Но более статистически недостоверных результатов, чем было получено в итоге, попросту трудно придумать. Вариант А (без названия бренда) — 22.75%. Вариант В — 22.73%. Разница составила невероятные 0,02%.

Из сотен тысяч разосланных писем с обоими вариантами, первый был открыт примерно на 20 раз чаще. Полученной информации было достаточно только для одного решения — использовать более серьезный подход к тестам.

Что же не так?

Во-первых, маркетологи могли усилить контраст между вариантами и протестировать совершенно другой текст в теме письма. Например, «Почему QuizUp оказался самой быстрорастущей игрой в истории социальных платформ?». Такой контраст имел бы куда больше шансов на статистически значимые результаты. Но даже тогда, как применить полученные данные? О чем они говорят? Возможно, после ряда более глубоких испытаний, маркетологи выяснили бы, какие темы больше нравятся получателям рассылки. Но так ли важна эта информация в отрыве от глобальной стратегии? Данный тест был выстроен плохо, поскольку не являлся частью глобальной стратегии оптимизации маркетинговых каналов и пользовательского опыта читателей.

То есть, если перед разработкой очередных сплит-тестов вы сформулируете несколько глобальных целей, которым подчинена вся маркетинговая активность, то получить от испытаний результат станет гораздо проще. Очевидно, вы хотите повысить число читателей/подписчиков, увеличить конверсию, средний чек, жизненный цикл клиента. Но только если вы четко видите, как повышение числа открытий рассылки связано с показателями конверсии и среднего чека, тогда сможете организовать все тесты, исходя из общих целей и одного пути. Казалось бы, это очевидные вещи — но многие забывают о них.

Хари Ананс (Hari Ananth), сооснователь стартапа Jobr, рассказывает о примере не столь бессмысленных сплит-тестов, проведенных с целью приобретения новых пользователей. Jobr — приложение для поиска работы, использующее механизм Tinder. То есть, соискатель «свайпит» варианты, листая понравившиеся в одну сторону, а малоинтересные — в другую

«Мы хотели увеличить поток новых пользователей, для чего определили два важнейших шага в своей воронке и создали широкий список вариантов для каждого эксперимента, дабы обеспечить достаточную достоверность. После проверки всех вариантов на приемлемом количестве трафика, мы смогли оптимизировать поток и повысить конверсию на 225%».

Вместо заключения

Данный пример неслучайно оказался столь эффективным и обошел все стандартные «подводные камни» сплит-тестов. Эксперименты были выстроены с целью проверки значимых аспектов продукта, оказывающих сильное влияние на поведение пользователей. И конечно, у маркетологов было достаточно трафика, времени и главное — вариантов, для получения статистической достоверности.

Поэтому, если вы до сих пор недоумеваете, где ваш рост конверсии на 38% (а лучше, на 380%) после смены цвета кнопки «Купить», то вот ответ. Потратьте время, чтобы выстроить значимые сплит-тесты — и получите значимые результаты.

Высоких вам конверсий!

По материалам: mixpanel.comImage source: unsplash.com